智慧眼鏡大混戰:科技巨頭戴上眼鏡,卡位下一代硬體入口!

2025年智慧眼鏡市場爆發,Meta 銷量成長 3倍、Apple 啟動 Project Atlas、Google 推Android XR 平台。為何大廠趨之若鶩?因為眼鏡是唯一能全天候採集第一視角數據的設備,是訓練世界模型的終極傳感器。本文拆解大廠策略、市場困境與供應鏈投資機會。

2025 年上半年,全球智慧眼鏡出貨量成長 110%,其中,Meta Ray-Ban 系列銷量成長 3 倍、產能規劃至年產 1,000 萬副;此外,Google 計畫於 2026 年推出語音助理型及顯示器型的智慧眼鏡;Apple 啟動 Project Atlas 內部研究。而在中國,智慧眼鏡更是有如雨後春筍冒出,包括阿里巴巴、小米、華為、理想汽車等品牌也都陸續推出智慧眼鏡。

這些公司不約而同地推出智慧眼鏡,是因為這是唯一能全天候、以第一視角採集使用者環境、行為與意圖的設備。而這些數據對於訓練理解並交互物理世界的世界模型至關重要。

這篇文章接下來將拆解四個關鍵問題:1) 為什麼是現在?為什麼是智慧眼鏡?2) 大廠如何破局?3) 供應鏈的投資機會在哪裡?4) 真正的智慧AI眼鏡何時到來?

為什麼 2025 年爆發?三重驅動力匯合

驅動一:生成式 AI 催生「隨時取用」需求

過去的 AI 模型是「被動反應」,你問一句,它答一句。現在 AI 正在轉向「主動判斷與建議」,根據環境、情境和使用者行為提前判斷需求並自動完成任務。

但想想看,手機的交互應用仍建立在使用者必須先發起動作的前提下:掏出手機、解鎖、打開 App、輸入內容。這種交互方式到了現在這個人工智慧時代顯得格格不入。

智慧眼鏡的優勢在於:

- 貼近視野:與使用者視線同步,直接看到使用者看到的

- 持續配戴:不需要「掏出手機與解鎖」動作

- 解放雙手:語音與視覺輸入,無需觸控

生成式 AI 的快速發展催生出一種新的使用者需求:「我希望隨時隨地使用人工智慧,或讓他替我完成各種任務,但不想每次都掏出手機,點擊不同的應用程式。」

所以眼鏡,自然成為承載下一代人機交互的可能入口之一。

驅動二:Vision Pro驗證空間計算潛力

Apple Vision Pro、Meta Quest已經展示了空間計算的潛力:計算不必局限在一小塊手機螢幕裡,而能與真實世界融合交互。

儘管這些設備形態笨重( Vision Pro 重量超過 600 公克)、續航有限、價格昂貴,但它們像是下一個世代的原型機,讓整個行業燃起一種樂觀的信心:

如果 Vision Pro 能夠做到這麼沉浸,如果 Quest 已經能做基本的空間理解,那麼把這些能力濃縮到 40 公克的眼鏡形態,只是時間的問題?

想想看幾十年前的大哥大手機跟現在的智慧型手機?行業逐漸形成一個共識:頭戴式裝置驗證了技術可行性,但眼鏡才是真正能普及的形態。

驅動三:資本押注「下一個 iPhone」

自智慧型手機成為主流設備以來,在過去十年中,所有的行業玩家都在尋找下一個入口。但智慧手錶、耳機、折疊螢幕等應用,都還只是在手機生態內循環,沒有獨立入口價值。

直到生成式 AI 出現,大家開始思考下一個載體?是手機嗎?是別針嗎?還是一種新的設備形態?

而智慧眼鏡因為具備以下特徵,成為資本押注的重點:

- 明確但未被佔領的品項

- 與 AI 使用情境天然搭配

- 想像空間接近 iPhone 誕生前的智慧型手機

於是在當下我們看到的所有現象,廣告、融資、創業潮、大廠跨界。並不是因為智慧眼鏡的想像已經兌現,而是整個行業正在爭奪對未來入口的敘事權。

為什麼是眼鏡?訓練世界模型的終極傳感器

智慧眼鏡是收集真實世界數據的最佳載體

如果只是為了「解放雙手」或「隨時使用 AI」,智慧手錶、耳機甚至植入晶片都能做到。但為什麼大廠們一致押注眼鏡形態?

核心原因在於:智慧眼鏡是唯一能全天候、以第一視角感知使用者所處環境、行為甚至意圖的設備。它能成為採集多維連續數據的終極傳感器,包括視覺、聲音、位置、注視點等。

這些數據對於訓練理解並交互物理世界的世界模型(World Model)至關重要。

| 設備 | 配戴時長 | 視角 | 數據連續性 | 環境感知能力 |

|---|---|---|---|---|

| 手機 | 間歇性 | 第三視角(需掏出) | 斷續 | 弱(依賴主動觸發) |

| 智慧手錶 | 全天候 | 無視覺輸入 | 連續 | 生理數據為主 |

| 智慧眼鏡 | 全天候 | 第一視角 | 連續 | 強(視覺+聲音+位置) |

手機只能在使用者主動掏出時才能「看見」世界,而且是第三視角,它所能看到的並不是使用者看到的。智慧手錶雖然全天候配戴,但沒有視覺輸入,只能採集生理數據。

只有智慧眼鏡,與使用者的視線完全同步,持續採集使用者的第一視角數據。這種數據的價值,遠遠超過任何其他設備形態。

世界模型訓練的關鍵:端對端感知

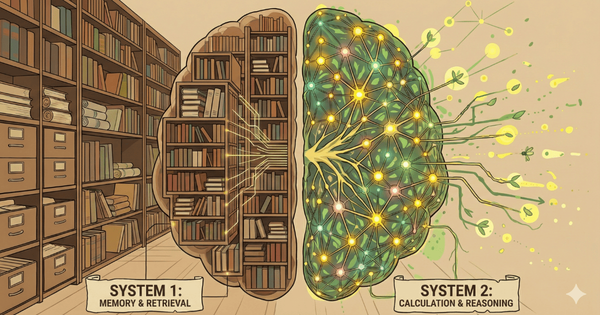

什麼是世界模型?

世界模型(World Model)是人工智慧模型內建的物理世界理解能力。它不只是統計機率關聯,而是真正理解因果關係、物理法則和邏輯推演。

如果你想要更多理解世界模型,可以參考我之前寫過的文章。

智慧眼鏡的價值就在於此:

1. 連續性學習

長時間採集使用者與環境的互動數據。AI 不只看到靜態場景,而是看到使用者如何與世界互動:

- 你看向冰箱時打開門

- 你注視紅綠燈後決定過馬路

- 你盯著菜單思考時最終點了哪一道菜

這些持續的、第一視角的互動數據,是訓練 AI 理解「人類如何與物理世界互動」的最佳素材。

2. 情境理解

眼鏡知道使用者在看什麼、說什麼、做什麼,能夠建立完整的情境理解。這與手機「被動等待指令」的邏輯完全不同。

舉例來說,它可以透過攝影機「看見」你看到的世界,進行即時對話。當你看著一棵植物問「這是什麼」,它知道你在問眼前這棵植物,當你看向餐廳時自動顯示評分,當你看向海報時,自動辨識活動資訊並搜尋訂票系統等等。

3. 意圖預測

最終極的目標是:根據環境和歷史行為預判需求,而不是等使用者開口。

比如 AI 發現:

- 你每天下午 3 點都看向咖啡機

- 你每次看菜單超過 10 秒就會選第二個選項

- 你在超市看到特定品牌會多停留 2 秒

這些行為模式,只有持續配戴的第一視角設備能捕捉。而手機永遠只能在你「掏出」那一刻才知道你在做什麼。

如果智慧眼鏡只是「螢幕 + 藍牙」,它永遠只是配件。只有當它成為持續蒐集環境數據、幫助 AI 理解物理世界的傳感器、更了解每一個使用者的行為模式,它才真正有資格成為「下一代計算入口」。

從訓練算力到推論算力:眼鏡的角色轉變

智慧眼鏡的另一個重要性在於,人工智慧模型從擴展時代走向了推理時代。

詳細內容可以參考過去的文章。但簡單來說,就是人工智慧模型在給出答案之前會先進行更多推論,而這些推論需要大量的訓練數據。

智慧眼鏡在這裡扮演什麼角色?

眼鏡提供大量真實場景的推論數據:

- 不是在實驗室裡訓練「看到杯子」

- 而是在真實環境中學習「使用者拿起杯子、喝水、放下」的完整流程

- 不是背誦「紅燈停、綠燈行」

- 而是理解「使用者看到紅燈時停下、看到綠燈時前進」的因果關係

這些理解是可以遷移的:

- 今天它理解了「使用者如何使用杯子」

- 明天它就能用同樣的邏輯去理解「機器人如何抓取物體」

- 後天它能理解「自駕車如何判斷行人意圖」

Tesla 的 FSD 訓練經驗可以遷移到 Optimus 機器人,Google 的視覺理解可以從文字生成遷移到空間計算。智慧眼鏡也是同樣邏輯,先在眼鏡上解決「純視覺環境理解」,未來就能遷移到任何需要視覺智慧的載體。

這就是為什麼這些公司願意投入資源在一個嶄新的硬體市場,持續押注智慧眼鏡。因為他們看到的不只是「一副眼鏡」,而是訓練下一代 AI 模型的終極數據來源。

一個混亂的初創市場

無統一定義:從「顯示器」到「AI助手」都叫智慧眼鏡

2025 年的智慧眼鏡市場最大的問題是:沒有人知道什麼才算「智慧」。

在一個成熟的消費電子品類中,沒有人會把遊戲機當作個人電腦,沒有人會把功能型手機認成智慧型手機。但智慧眼鏡卻處在一個極度尷尬的階段:任何有鏡片、螢幕會顯示、能連藍牙的設備,都給自己貼上「AI」標籤。

市場上的產品大致可分為四類:

| 類型 | 核心能力 | 代表產品 | 價格帶(台幣) | 重量 |

|---|---|---|---|---|

| 顯示型眼鏡 | 投影看片 + 藍牙連接 | 大量白牌產品 | 3,000-6,000 | 40-60g |

| 可互動眼鏡 | 雲端AI + 語音助手 | 小米、華為、百度 | 6,000-9,000 | 40-50g |

| AI拍攝眼鏡 | 拍攝 + AI + 輕量 | Meta Ray-Ban、理想Livis | 5,100-6,000 | 35-49g |

| AI+AR眼鏡 | 顯示 + AI + 拍攝 | 夸克S1 | 12,000-27,000 | 50-70g |

真正智慧眼鏡:五大能力缺一不可

然而,任何要被稱為「AI 智慧眼鏡」的設備,都必須同時具備五項基礎能力:

- 本地計算能力(On-Device ML):能在設備端進行AI推論,不完全依賴雲端

- 空間理解能力(SLAM/Scene Understanding):理解三維空間、物體位置、遮擋關係

- 即時互動(Low-Latency Interaction):延遲低於50毫秒,使用者無感

- 續航與重量(Ergonomics/Power Efficiency):重量低於50公克、全天候配戴

- 多模態 AI(Vision+LLM+Multimodal):整合視覺、語言、情境的 AI 能力

用白話文來說,智慧眼鏡必須是一款能夠看見世界、理解世界、並隨時與你共用一個現實環境的人工智慧設備。

按這套標準看,現在市面上其實還沒有一款真正意義上的智慧眼鏡。

整個產業還停留在從原型機往輕量化探索的階段。

投資機會:供應鏈的黃金賽道

雖然智慧眼鏡想要成為主流產品,還有很長遠的路要走。畢竟像 google 就已經在這條路上走走停停好幾回。但在各國大廠爭相投入下,我認為還是有一些技術發展方向值得關注。

四大值得關注的技術方向

方向一:Micro-LED顯示技術

為什麼值得關注?

- 技術優勢:超越 OLED 和 LCoS 的峰值亮度(600 尼特以上)、對比度、無烙印問題

- 應用場景:特別適合戶外使用的 AR 眼鏡

- 市場地位:AR 眼鏡顯示技術目前的唯一解,沒有替代方案

方向二:光波導光學技術

為什麼值得關注?

- 成本占比:光學組件在 AI/AR 眼鏡物料清單中佔比 40-70%

- 核心價值:決定視角、成像品質、眼鏡厚度

- 技術壁壘:專利門檻高,技術集中度高

- 差異化來源:不同光波導方案(繞射式、反射式、幾何式)決定產品競爭力

方向三:AI晶片與處理器

為什麼值得關注?

- 產品核心:端側 AI 運算決定使用體驗

- 差異化關鍵:AI 回應速度、電池續航、本地算力

- 技術趨勢:從雲端 AI 轉向端側 AI,需要高效能低功耗晶片

- 競爭優勢:ASIC 客製化晶片成為差異化競爭手段

未來展望:真正的智慧眼鏡何時到來?

當前困境:硬體與軟體的雙重瓶頸

硬體限制:

- 算力vs重量:無法在 40 公克鏡框塞手機級晶片

- 電池vs續航:微型電池無法支撐持續 AI 推論

- 散熱vs配戴:發熱晶片不能貼近臉部

軟體瓶頸:

- SLAM 技術永遠「慢半拍」(看到之後再處理)

- 需要從「被動反應」升級為「主動預測」

- 目前無廠商做到

所以,智慧眼鏡目前可能處於 L2-L3 過渡階段(智能輔助級→智能助理級),預計 2027 年才會進入 L4(真正的計算終端)。

序章而非終局

智慧眼鏡的風口是真實的,2025 年的熱潮背後有紮實支撐:AI 需要新入口、空間計算要落地、更重要的是,眼鏡是訓練世界模型的最佳傳感器。

但真正的智慧眼鏡尚未出現,而現在的一切只是序章。就像 AirPods 花了 3-4 年才真正普及,智慧眼鏡也需要時間。但不同的是,這次的賭注更大。

誰能做出真正有用的智慧眼鏡,誰就掌握了下一個十年的計算入口。

數據來源與延伸閱讀

相關文章: